数据治理与数据处理服务 构建企业智能核心的万字全景指南

在数字经济时代,数据已成为企业的核心资产和战略资源。原始数据如同未经雕琢的璞玉,其价值潜藏于混沌之中。数据治理与数据处理服务,正是将原始数据转化为可信任、可运营、可洞察的智慧资产的关键工程。本文旨在系统性地阐述数据治理的完整框架与数据处理服务的落地实践,为企业构建坚实的数据基石提供全景式指南。

第一部分:数据治理——奠定数据价值的基石

第一章:理解数据治理的本质与价值

数据治理并非单纯的技术项目,而是一套涵盖战略、组织、流程、技术与文化的系统性管理体系。其核心目标是确保数据在其全生命周期内的可用性、完整性、安全性、一致性、合规性与可信性,从而赋能业务决策、驱动运营效率、保障合规风控并释放创新潜能。缺乏有效治理的数据,往往导致“数据孤岛”、质量低下、口径不一、安全风险与合规隐患,最终使得数据资产沦为数据负债。

价值体现:

- 提升决策质量:基于高质量、一致性的数据,支撑精准分析与智能决策。

- 优化运营效率:通过标准化流程与自动化工具,减少数据查找、清洗与整合成本。

- 保障合规与风控:满足日益严格的国内外数据法规(如GDPR、个保法),管控数据安全风险。

- 驱动业务创新:为数据分析、客户洞察、产品智能化提供可信数据底座。

- 培育数据文化:在企业内部建立共享、共治、信任的数据应用氛围。

第二章:数据治理的核心框架与核心领域

一个完整的数据治理框架通常包含以下核心组件:

- 战略与组织:

- 治理战略:明确数据治理的愿景、目标、原则,并与业务战略对齐。

- 组织架构:建立多层级的治理组织,如决策层的数据治理委员会、管理层的数据治理办公室、执行层的数据管家(Data Steward)与数据所有者(Data Owner)。明确角色与职责。

- 政策与制度:制定企业级的数据管理政策、标准、流程与考核机制。

- 核心治理领域:

- 数据架构治理:设计和管理企业级数据模型、数据流、数据存储架构,确保结构合理、集成顺畅。

- 数据标准治理:统一数据定义(业务术语、数据字典)、数据格式、编码规则、模型规范等,消除歧义。

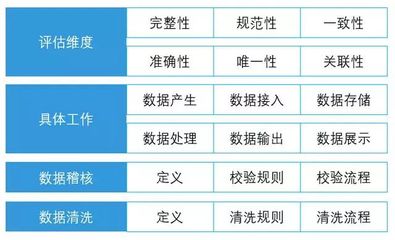

- 数据质量治理:建立数据质量度量维度(准确性、完整性、一致性、及时性、唯一性、有效性),定义质量规则,实施全流程的监控、评估、告警与修复闭环。

- 数据安全与隐私治理:进行数据分类分级,定义访问控制策略(角色、权限),实施数据脱敏、加密、审计,确保个人隐私与商业机密保护。

- 数据生命周期治理:管理数据从创建、存储、使用、归档到销毁的全过程,平衡数据价值与存储成本、合规要求。

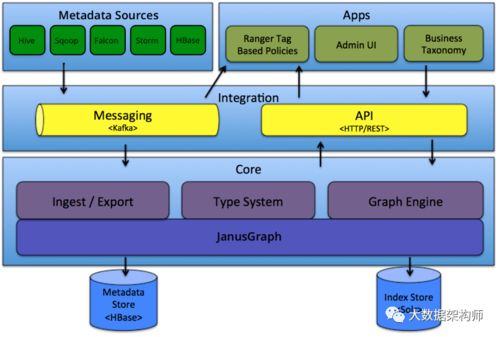

- 元数据治理:统一管理“关于数据的数据”(技术元数据、业务元数据、操作元数据),实现数据资产的“地图”与“溯源”能力。

- 赋能平台与工具:

- 引入或开发数据治理工具链,如元数据管理、数据质量、数据标准、主数据、数据安全等平台,提升治理自动化与效率。

- 文化、沟通与培训:

- 通过培训、宣传、激励措施,提升全员数据意识与技能,推动治理文化落地。

第三章:数据治理的实施路径与挑战应对

实施路径建议采用“顶层设计、分步实施、急用先行、迭代演进”的策略:

- 评估与规划阶段:评估数据管理现状(成熟度评估),识别关键痛点与优先级,制定详细的实施路线图。

- 试点与建设阶段:选择1-2个关键业务域或高价值数据主题(如客户、产品)作为试点,建立组织、制定核心政策标准、部署基础工具,快速展现价值。

- 推广与深化阶段:将试点经验推广至更多业务领域,完善治理体系,深化技术与业务的融合。

- 运营与优化阶段:将数据治理工作常态化、流程化,持续监控、度量和优化治理效果。

主要挑战与应对:

组织与文化阻力:通过高层强力支持、明确业务价值、有效沟通与激励来化解。

技术与架构复杂性:采用渐进式架构演进,优先整合关键系统,利用现代数据平台(如数据湖、数据湖仓一体)。

* ROI衡量困难:将治理价值与业务成果挂钩(如提升营收、降低成本、规避罚款),量化关键指标。

第二部分:数据处理服务——激活数据价值的引擎

数据治理奠定了数据“管好”的基础,而数据处理服务则是将数据“用好”的直接体现。它是一系列将原始数据转化为可用、可分析、可服务化数据的活动与能力的集合。

第四章:数据处理服务的全景视图与核心流程

数据处理服务覆盖数据从源系统到最终消费的完整流水线,通常遵循以下核心流程(数据处理流水线):

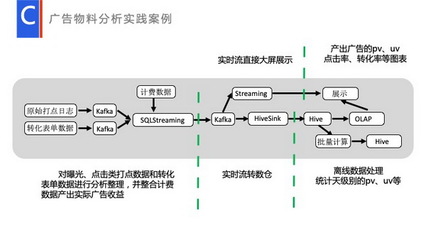

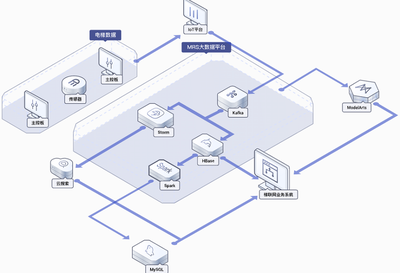

- 数据采集与集成:从异构数据源(业务数据库、日志文件、IoT设备、外部API等)实时或批量地抽取数据。关键技术包括ETL(提取、转换、加载)、ELT、CDC(变更数据捕获)、数据复制等。

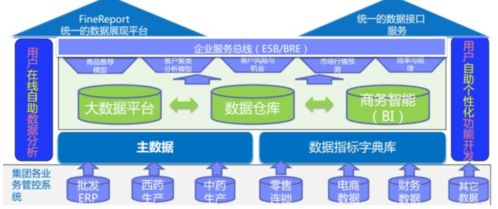

- 数据存储与组织:根据数据特性和使用场景,选择适当的存储方案,如关系型数据库、NoSQL数据库、数据仓库、数据湖、数据湖仓一体平台,并合理组织数据分层(如ODS原始层、DWD明细层、DWS汇总层、ADS应用层)。

- 数据加工与开发:这是数据处理的核心环节,包括:

- 数据清洗:纠正错误、处理缺失值、去除重复、格式化数据。

- 数据转换:进行数据结构的转换、关联、聚合、计算衍生指标。

- 数据建模:根据业务需求构建主题域模型、维度模型、指标模型等。

- 任务编排与调度:自动化管理复杂的数据处理任务依赖与执行顺序。

- 数据服务与交付:将处理后的数据以安全、高效、便捷的方式提供给消费者(BI报表、数据分析师、业务系统、API调用等)。形式包括数据API、数据集市、数据产品、分析报告等。

- 运维与监控:对整个数据处理流水线的健康度、性能、数据质量、任务成功率进行全方位监控、告警与故障恢复。

第五章:关键技术与平台选型

- 批处理与流处理:根据业务时效性要求,选择批处理(Hadoop, Spark)处理历史数据,或流处理(Flink, Kafka Streams)处理实时数据流,或采用Lambda/Kappa架构结合两者。

- 云原生数据平台:利用云服务(如AWS Glue, Azure Data Factory, 阿里云DataWorks)的弹性、托管服务能力,降低运维复杂度。

- 数据湖与数据仓库的融合:采用湖仓一体(Databricks Lakehouse, Snowflake)架构,兼顾数据湖的灵活性与数据仓库的性能与管理能力。

- 数据Ops与Data Mesh:借鉴DevOps理念,实现数据处理流程的敏捷开发、自动化部署与协同;DataMesh理念倡导去中心化的、面向领域的分布式数据架构,提升大规模数据处理的敏捷性。

- 智能化数据处理:利用AI/ML技术进行智能数据分类、自动质量检查、异常检测、元数据自动发现与关联。

第六章:构建高效、可靠的数据处理服务体系

- 以服务为导向:将数据处理能力包装成内部服务,明确SLA(服务等级协议),建立服务目录,让业务方能够像使用水电一样方便地获取数据。

- 标准化与模块化:制定数据处理开发规范、代码模板、组件库,提升开发效率与可维护性。

- 质量内建与可观测性:在数据处理每个环节嵌入质量检查点,建立端到端的数据血缘追踪,实现数据处理过程的全链路可观测。

- 安全与合规贯穿始终:在数据处理流程中严格执行数据安全策略,如敏感数据识别、动态脱敏、访问日志审计。

- 团队与能力建设:组建包含数据工程师、数据开发、平台运维在内的专业团队,并持续培养其技能。

第三部分:治理与处理的融合——通往数据驱动的未来

数据治理与数据处理服务并非孤立的两个部分,而是相辅相成、螺旋上升的统一体。

- 治理指导处理:数据治理产生的政策、标准、质量规则,是数据处理服务开发与运营必须遵循的“宪法”。例如,数据标准决定了数据转换的规则,安全分级决定了数据服务输出的过滤与脱敏策略。

- 处理反馈治理:数据处理过程中发现的元数据、数据质量问题、业务需求变化,又反过来驱动数据治理策略、标准与流程的优化和演进。

最佳实践融合模式:

1. 在数据平台层面,将治理工具(元数据、质量、安全)与数据处理引擎(计算、存储)深度集成,实现“治理即代码”、“治理入流程”。

2. 在组织层面,让数据治理团队与数据工程/开发团队紧密协作,共同参与从需求到上线的全流程。

3. 在流程层面,建立从数据需求提出、模型设计、开发测试到上线运营的协同工作流,确保治理要求被有效执行。

结论

数据治理与数据处理服务是企业数字化转型不可分割的“一体两翼”。前者确保数据是可信、合规、一致的资产,后者确保资产能够被高效、灵活、安全地加工和消费。成功的实践始于清晰的战略与坚定的组织承诺,成于科学的框架与持续的技术运营,终于深入人心的数据文化与源源不断的业务价值回报。

面对海量、多样、快速变化的数据环境,企业应摒弃“先污染后治理”或“重技术轻管理”的片面思维,转而拥抱一种体系化、常态化、技术与管理并重的建设思路。通过构建坚实的数据治理基石与敏捷的数据处理服务引擎,企业方能真正驾驭数据洪流,将数据潜力转化为无可争议的竞争优势,稳健地航行于智能时代的浪潮之巅。

如若转载,请注明出处:http://www.co-toker.com/product/23.html

更新时间:2026-05-30 22:06:09